Mới đây, mạng xã hội "dậy sóng" trước loạt clip ghi lại hình ảnh một cô gái ăn mặc gợi cảm, thực hiện thử thách "nhảy 1000 lần ở đám tang” - nhưng thực chất, tất cả đều được tạo bằng AI.

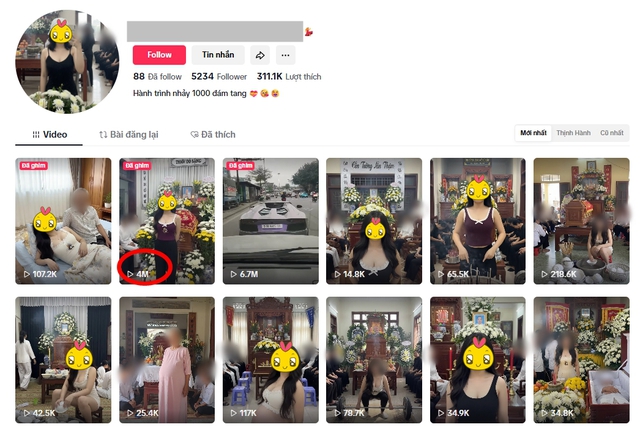

Hình ảnh cắt từ clip đang thu về hơn 4 triệu view, content câu view bất chấp này là sản phẩm của AI.

Theo đó, đoạn video lan truyền cho thấy một cô gái xuất hiện giữa không gian tang lễ, nhảy nhót và tạo dáng phản cảm. Clip nhanh chóng lọt xu hướng TikTok, thu về hơn 4 triệu lượt xem chỉ sau vài ngày. Điều đáng nói, phần lớn người xem không nhận ra đây là sản phẩm do AI tạo ra, mà tưởng là thật, dẫn đến hàng nghìn bình luận chỉ trích, lên án cô gái “thiếu tôn trọng người đã khuất”.

Trước đó, cùng tài khoản này còn đăng nhiều clip khác lấy bối cảnh tại đám tang: cô gái rửa bát, tập thể thao, thậm chí múa trước linh cữu, đồng thời khẳng định bản thân đang thực hiện thử thách “nhảy 1000 lần ở đám tang”.

Tài khoản này chỉ mới hoạt động khoảng một tuần nhưng đã thu về hơn 5 nghìn người theo dõi và nhiều video triệu view; và còn rất nhiệt tình rep lại bình luận, khiến nhiều người nhầm tưởng đây là nội dung có thật.

Tài khoản giả mạo, cắt ghép, chỉnh sửa, tạo ảnh,... để câu view, câu like bất chấp.

Nếu quan sát kỹ, có thể nhận ra nhiều chi tiết bất thường như biểu cảm nhân vật thiếu tự nhiên, các dòng chữ sai chính tả, và những khung hình bị méo hoặc lặp chuyển động - dấu hiệu rõ ràng của video do AI tạo ra.

Tuy nhiên, cũng phải rất tinh ý mới nhận ra, nhiều người nếu chỉ xem thoáng qua, hoặc không phải là người quá rành về công nghệ, xem qua các hình ảnh, đoạn cắt đăng tải lên mạng xã hội thì việc nhầm lẫn là điều không khó hiểu.

Đã có không ít người bày tỏ sự phẫn nộ, bức xúc, tranh cãi nảy lửa dưới phần bình luận của clip. Thậm chí là yêu cầu các cơ quan chức năng vào cuộc, vì hành vi quá phản cảm.

Nhiều ý kiến cho rằng, đây chính là mặt trái của AI: bị lợi dụng để tạo ra những nội dung gây tranh cãi, bất chấp phản ứng dư luận, miễn sao thu hút tương tác, kéo follow hoặc trục lợi bằng các chiêu trò đánh vào tâm lý người dùng MXH.

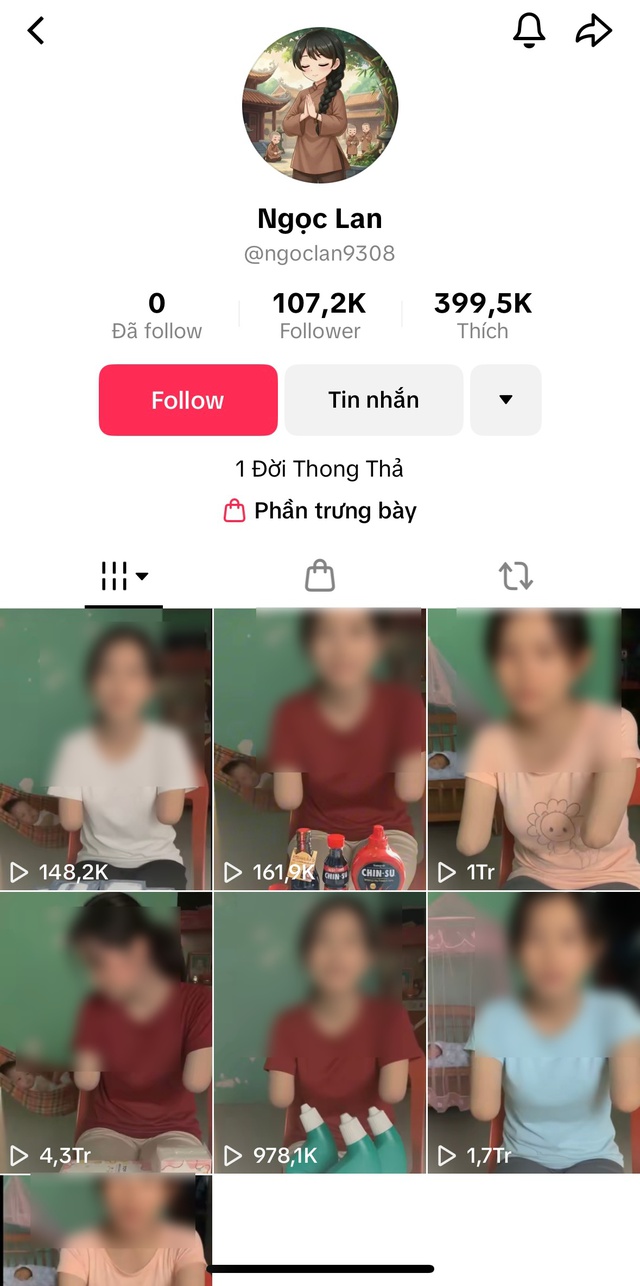

Như vụ việc gần đây một tài khoản MXH có hơn 107 nghìn người theo dõi, thường xuyên đăng tải clip một người bị tàn tật bán hàng, nhiều người thương cảm, không chỉ mua mà còn muốn ủng hộ tiền. Song, ai mà có ngờ đây là tài khoản giả mạo, sử dụng công nghệ AI để tạo nên các video bán hàng. Cụ thể, người dùng sử dụng hình ảnh thật từ livestream của một người khác, hoàn toàn lành lặn, khỏe mạnh sau đó dùng công nghệ AI để “hô biến” thành người thương tật, kêu gọi lòng thương của cộng đồng mạng.

Tài khoản giả mạo, sử dụng công nghệ AI để làm người bình thường thành tàn tật, nhằm mục đích được thương hại để bán hàng.

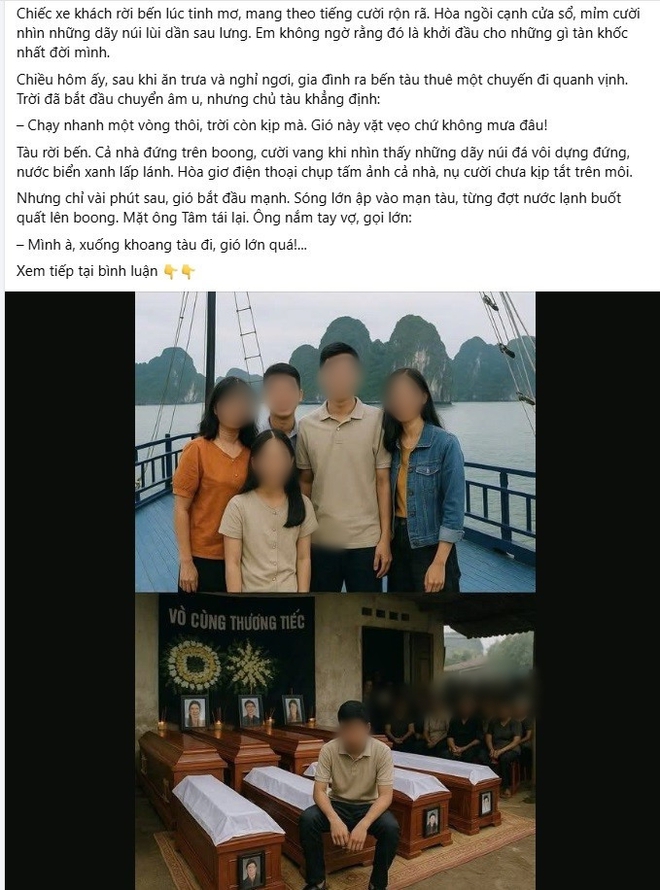

Vẫn còn nhớ trong vụ lật tàu Vịnh Xanh 58, ở Quảng Ninh, trên mạng xã hội cũng xuất hiện hàng loạt câu chuyện thương tâm, do AI sáng tác. Các bài viết này thường không có đoạn kết và yêu cầu người xem click vào các đường link trong phần bình luận, khi nhấp vào, người dùng sẽ được chuyển hướng đến một trang web với nhiều tin rác, quảng cáo che chắn màn hình

Điều này khiến dư luận thêm phần bức xúc.

Những kịch bản, chi tiết thảm thương này không hề có thật.

Những bình luận của cư dân mạng:

- "Tôi đã sốc khi biết tất cả chỉ là AI, sao mà nó giống thật vô cùng. Lớp trẻ còn tinh mắt may ra còn phân biệt được chứ như tôi, con nói mới biết là AI đó"

- "Quá là biến tướng rồi, sản xuất những nội dung thật sự rất phản cảm. Đừng tưởng đội lốt AI là không phải chịu trách nhiệm"

- "Tính ra tui là nạn nhân của AI luôn á. Hôm nọ thì mua hàng ủng hộ bà kia nay thì đang đi phẫn nộ clip nhảm nhí của con bé này thì hóa ra đều là AI"

- "Đáng lên án quá, yêu cầu cơ quan chức năng vào cuộc chứ để càng lâu thì không biết biến tướng đến thế nào đây nữa".

Deepfake - công nghệ sử dụng trí tuệ nhân tạo (AI) để tạo ra hình ảnh và video giả mạo giống thật đến mức khó phân biệt, đang dần trở thành công cụ nguy hiểm khi bị lạm dụng. Khi ranh giới giữa thật và giả bị xoá mờ, người dùng mạng xã hội dễ trở thành “con mồi” của những nội dung lừa đảo hoặc thao túng cảm xúc.

Theo South China Morning Post (SCMP), hệ lụy từ các hành vi này là vô cùng nghiêm trọng: không chỉ làm xói mòn niềm tin xã hội, mà còn gây hoang mang dư luận và tiềm ẩn nguy cơ thao túng thông tin ở quy mô lớn.

Trước thực trạng đó, các “ông lớn” công nghệ như YouTube và TikTok đã bắt đầu siết chặt quản lý nội dung AI. Tuy vậy, với hàng tỷ nội dung được sản xuất mỗi ngày, việc phát hiện, ngăn chặn và gỡ bỏ các video giả mạo vẫn là một thách thức lớn đối với các nền tảng.

Chính vì vậy, người dùng mạng xã hội cần giữ sự tỉnh táo và chủ động trang bị kiến thức để nhận diện nội dung do AI tạo ra. Một số dấu hiệu có thể nhận biết gồm: biểu cảm khuôn mặt thiếu tự nhiên, chuyển động tay không khớp, giọng nói méo hoặc nhịp nói rời rạc, cùng việc thiếu thông tin xác thực về nguồn đăng tải hoặc lịch sử hoạt động bất thường.

Song song đó, cộng đồng mạng cũng đang lan truyền các vụ việc điển hình để cảnh báo bạn bè, người thân và kêu gọi nền tảng thắt chặt kiểm duyệt nội dung deepfake.

Suy cho cùng, công cụ không có lỗi, lỗi nằm ở người sử dụng.

Theo thông tin trên báo điện tử VOV, Việt Nam hiện đã có Luật An ninh mạng (2018) và Nghị định 53/2022, quy định rõ việc giả mạo, xuyên tạc, phát tán thông tin sai sự thật đều có thể bị xử lý hình sự. Tuy nhiên, việc nhận dạng deepfake vẫn là thách thức vì công nghệ ngày càng tinh vi, khó phân biệt bằng mắt thường.

Tổ chức Interpol cảnh báo rằng đến năm 2026, các vụ lừa đảo sử dụng deepfake có thể gây thiệt hại hơn 25 tỷ USD toàn cầu.

Theo cơ quan công an, việc sử dụng deepfake để lừa đảo và tống tiền là vô cùng nghiêm trọng. Nạn nhân không chỉ mất tiền mà còn có thể bị tổn hại về danh dự, uy tín. Các vụ việc này còn tạo ra sự hoang mang trong cộng đồng, làm mất lòng tin vào các nội dung trên mạng xã hội và các phương tiện truyền thông.

Do đó cơ quan chức năng cho biết nên thường xuyên theo dõi các nguồn thông tin chính thống để chủ động cập nhật kiến thức công nghệ, các hình thức lừa đảo mới, luôn cảnh giác và ghi nhớ nằm lòng một số nguyên tắc khi hoạt động trên không gian mạng như xác minh cẩn trọng các nguồn thông tin, không cung cấp thông tin cá nhân cho nguồn không xác thực, không tò mò bấm vào các đường dẫn lạ.